Техносемантика жеста: о возможностях использования пермской жестовой нотации в программно-генерируемых средах

Aннотация

Статья посвящена разработке концепции и программного решения генерации движений человека на основе созданной коллективом семантико-ориентированной жестовой нотации. Нотация представляется в виде формулы, отличающейся гибкой структурой понятий и правил их реализации, что позволяет легко адаптировать изменения параметров движения для соответствия идеальному или реальному образцу.

Для моделирования движений, представленных в языковой нотации, разработано кроссплатформенное приложение на базе игрового движка Blender 4.2 для визуализации и генерации анимации жестов антропоморфных моделей. Система управления движений состоит из следующих стадий: запись жестовой нотации; разбор этой записи; построение внутреннего представления движения, которое является последовательностью ряда кадров. Кадры имеют информацию о том, к какой кости (части тела) исполнителя они относятся, как влияют на её положение, в какой момент времени от начала движения этот кадр актуален. На последнем этапе осуществляется преобразование внутреннего представления движения в движение исполнителя, в качестве которого могут выступать как виртуальные антропоморфные 3D-модели, так и материальные программно-аппаратные комплексы в виде антропоморфных роботов.

Для большего соответствия антропоморфному поведению помимо «идеальных образцов» движения человека были использованы модели жестового поведения людей, представленные в специально создаваемом для этой цели коллективом мультимодальном корпусе. Материал представляет собой аудиовизуальные записи устных спонтанных текстов описания реципиентами широкого спектра собственных эмоциональных состояний. Полученные в ходе экспериментального исследования данные подтвердили гибкость, повышенную контролируемость и модульность языковой нотации, возможность моделирования непрерывного пространства человеческой двигательной активности.

Ключевые слова: Техносемантика, Генерация движений, Языковая нотация жестов, Жест, Визуализация, Мультимодальный корпус, 3D-графика, Интерпретируемость

Введение

Разработка систем описания движений человека является актуальной задачей в различных областях деятельности, таких как хореография, робототехника, анимация и мн.др. Подобно тому как музыкальная партитура представляет музыкальные ноты, нотация движений призвана передать точные инструкции в отношении конкретных движений, действий, а также их комплексов и/или последовательностей. Создание нотаций, позволяющих описывать движения в разных предметных областях, сталкивается с рядом проблем. Первая проблема заключается в отсутствии универсального языка для записи движений. Различные предметные области используют отличающиеся друг от друга методы и языки для записи движений, что приводит к ситуации «Вавилонской башни», когда общение между дисциплинами становится затруднительным (Laumond, Abe, 2016). Вторая проблема возникает из-за уже сложившихся в разных предметных областях своих терминосистем, парадигм и целей (ср. хореографию и робототехнику), что еще больше усложняет междисциплинарное общение и препятствует интеграции наук (Calvert, 2015).

В то же время метаязыковая и концептуальная фрагментарность дисциплинарных областей входит в противоречие с качественными изменениями в природе человеческой коммуникации и деятельности, обусловленными выдвижением на передний план интерфейсно-опосредованной коммуникации и цифровизации многочисленных форм деятельности. Такая коммуникация требует универсальных «бесшовных» инструментов (метаязыка и технологий) для перехода от одной формы человеческой активности к другой. Отсюда вытекает потребность в поиске новых, возможно универсальных, подходов к описанию взаимодействия человека и машины (HMI) и взаимодействия человека и компьютера (HCI).

Электронные вычислительные устройства и виртуальные антропоморфные 3D-модели, такие как роботы и виртуальные аватары, имитируют поведение человека, общение, эмоции, движения, жесты и другие человеческие черты и поведенческие паттерны. Поскольку эти антропоморфные модели становятся все более интегрированными в повседневную жизнь, они должны уметь оперировать множеством человеческих действий и языковых выражений. Если мы говорим о движениях человека, то для эффективного взаимодействия с людьми и извлечения информации из лингвистических и жестовых данных, эти интеллектуальные модели должны понимать референциальные отношения между действиями и языком, а также интерпретировать действия, передаваемые через язык.

Разработка осязаемых человеко-машинных интерфейсов основывается на принципах человеческого общения, где информация воспринимается, обрабатывается и передается с использованием нескольких модальностей (Belousov et al., 2024). Семантика в этом контексте охватывает не только слуховые или визуальные сообщения, но и моторные действия. Например, ван Элк и коллеги описывают семантику действий как иерархически организованную систему, подсистемы которой избирательно активируются в зависимости от намерений субъекта и контекста задачи (van Elk et al., 2009). В естественной коммуникации передача информации осуществляется сразу по нескольким каналам разной модальности для «сужения» и фокусирования области смысла, например, пространственный дейксис в ситуации непосредственного общения требует жестового участия: «Посмотри там!» (указание рукой или кивком головы).

Обычно проблема описания движений связана с обсуждением различий между движениями и жестами. Существует несколько подходов к различению движения и жеста. Так, движение можно рассматривать как понятие, которое охватывает любую физическую активность тела, в том числе и жесты, которые, в свою очередь, несут символическое значение в коммуникации (Bull, Doody, 2013; Kendon, 1997; Kilpatrick, 2020; Murillo et al., 2021; Novack, Wakefield, 2016: 340; Stults-Kolehmainen, 2023). Согласно подходу А.М. Новака и коллег жест не связан с непосредственным изменением мира (например, открытие банки путем ее поворота) или не отображает образцы движения (например, выполнение шагов в танце), а вместо этого представляет движение, которое может изменить мир (например, жест, показывающий, как можно открыть банку, повернув ее), или представляет движение, которое существует само по себе (например, жест, показывающий, как следует исполнять танец) (Novack, Wakefield, 2016: 340). Оба приведенные примера, на наш взгляд, в целом корректны, однако можно обнаружить контексты, в которых танцевальные движения или открытие банки можно рассматривать в качестве жестов. Так, профессиональные танцевальные движения (например, в балете) коммуникативно и семантически нагружены и будучи обращены к зрителю интерпретируются, подобно тому, как интерпретируется любой другой знак. Пример свещественным преобразованием мира ("открытие банки" и под.), также можно погрузить в контекст, в котором такое преобразование может рассматриваться как знак профессионального мастерства.

Нам ближе понимание взаимосвязи жеста и движения, в котором движение является не только родовым понятием для жеста, но и объединяет их в следующих друг за другом последовательности (Kendon, 1997; Kilpatrick, 2020; Streeck, 2010; Trujillo et al., 2018). При этом если фрагмент движения коммуникативно направлен и семантически целостен, то его можно рассматривать в качестве жеста. Но заметим, что точно такое же движение может и не являться жестом, если оно не имеет адресата, способного интерпретировать данный знак (в качестве адресата может выступать сам адресант, т.е. речь идет об автокоммуникации).

В современном технологичном мире жесты являются формами невербального общения, используемыми не только для взаимодействия с людьми, но также с антропоморфными виртуальными или роботизированными моделями. Запись человеческих движений, разработка моделей и алгоритмов для эффективного распознавания движений, создание единой нотации движений и улучшение человеко-машинной коммуникации являются актуальными задачами в науке, робототехнике, машинном обучении и многих других областях.

Цели нотации движений включают – будь то в танце, анимации или робототехнике, – и предоставление четких, интерпретируемых инструкций, которые могут быть выполнены исполнителями, машинами или цифровыми персонажами. Точная нотация движений необходима для их настоящего и будущего использования, изучения или воспроизведения, обеспечивая согласованность в различных ситуациях и среди различных исполнителей (как людей, так и антропоморфных моделей). В этой статье мы представляем новую концепцию и программное решение для моделирования и генерации движений на основе семантически ориентированной языковой нотации, названной нами Пермской жестовой нотацией. Основная задача этой статьи – представить методологию моделирования человеческих движений на основе разработанной языковой нотации. Это включает представление разработанной нотации, описание приложения, реализующего систему управления движениями, основанного на движке Blender 4.2. В разработанном приложении осуществляется визуализация и генерация движений для антропоморфных моделей, а также композиционное и последовательное управление сгенерированными движениями на основе разработанной нотации. Для достижения правдоподобности антропоморфного поведения 3D-модели мы используем мультимодальный корпус аудиовизуальных записей описания людьми различных эмоциональных состояний. Это подтверждает возможность моделирования широкого спектра человеческих моторных действий.

Теоретический обзор

Создание системы нотации движений имеет многовековую историю. С XV века в Европе и Северной Америке использовалось как минимум 87 различных систем нотации движений (Abbie, 1974; Farnell, 1996; Guest, 1984; Key, 1977). Эти системы часто возникали для документирования определенных стилей танца или жестов (языков жестов), и многие из них выходили из употребления по мере эволюции или исчезновения связанных с ними практик движения (Farnell, 1996).

В области исследований невербального общения любая попытка разработать алфавит движений неизбежно должна учитывать значимые системы из истории нотации движений, включая систему Бошана-Фёйе, которая процветала при французском дворе в XVII и XVIII веках, систему жестов для публичных выступлений Гилберта Остина 1806 года, кинесику Рэя Бёрдвистелла середины XX века, систему записи американского языка жестов Уильяма Стокое и адаптации для других языков жестов Адама Кендона и Ла Монта Веста младшего, обобщенные системы нотации движений, такие как Лабанотация, анализ движений Лабана, хореология Бенеша и нотация Эшкола-Вахмана, которые предназначены для адаптации к различным формам движений и функционируют как Международный фонетический алфавит для движений, способный записывать любое телесное действие, сохраняя его семантическое содержание (Abbie, 1974; Bashan et al., 2024; Benesh, Benesh, 1956; Bernardet et al., 2019; Birdwhistell, 1952; Dell, 1977; El Raheb, Ioannidis, 2014; 2023; Eshkol, Wachmann, 1958; Farnell, 1996; Frishberg, 1983; Grushkin, 2017; Guest, 1984; 2005; Harrigan, 2008; Kendon, 1997; Key, 1977; Laban, Lawrence, 1974).

Несколько ключевых систем описаний движений возникли из смежных областей антропологии, этологии и психологии. Система кодирования лицевых действий (FACS) (Ekman, Friesen, 1978) предназначена для анализа и интерпретации мимических выражений путем идентификации конкретных лицевых действий. Бернская система (Frey et al., 1982) предлагает методологию для анализа движений в психологических и антропологических исследованиях. Самая последняя система – система кодирования телесных действий и поз (BAP) (Dael et al., 2012) разработана для детального анализа движений и поз тела с использованием 141 поведенческой переменной, фиксирующей сложные временные сегменты движения. Эти системы предоставляют обширный инструментарий для изучения невербального общения и человеческого поведения в различных научных и прикладных контекстах (Bernardet et al., 2019).

Системы классификации, кодирования и интерпретации движений различаются по ряду параметров, определяющих их целевое назначение, происхождение, уровень детализации и надежность. Во-первых, эти системы различаются по своему назначению: одни предназначены для воспроизведения или анализа движений, в то время как другие направлены на создание заключения/выводов о субъекте, выполняющем движения. Например, системы, происходящие из области танца, такие как Лабанотация и анализ движений Лабана, сосредоточены на точной передаче и анализе движений танцоров. Напротив, системы, возникшие из антропологии, этологии и психологии, такие как FACS и кинесика, направлены на изучение и интерпретацию человеческого поведения в более широком контексте (Birdwhistell, 1952; Bernardet et al., 2019; Duprey et al., 2017; Ekman, Friesen, 1978; Laban et al., 1974).

Во-вторых, уровень субъективного вывода различается среди разных систем. Некоторые системы полагаются на субъективные суждения кодировщиков, другие используют систематические метки и наблюдательное кодирование, а третьи – на прямое измерение мышечной активности. Это различие особенно важно при выборе системы для научных исследований, где требуется высокая точность и надежность данных (Bernardet et al., 2019).

Фокус на качестве или типе движения также является отличительной чертой различных систем. Например, Лабанотация и Бернская система подчеркивают качество движения, тогда как кинесика концентрируется на типах движений. Уровень детализации системы, включающий такие параметры, как минимальная временная единица для кодирования, размер алфавита (количество различных кодов) и количество одновременно кодируемых дорожек (частей тела), играет ключевую роль в определении уровня детализации системы. Чем меньше временная единица, больше алфавит и больше дорожек, тем более детальной является система. Это, в свою очередь, влияет на время кодирования: детализированные системы требуют значительно больше времени для кодирования данных, чем менее детализированные (Birdwhistell, 1952; Bernardet et al., 2019; Dael et al., 2012; Ekman, Friesen, 1978; Farnell, 1996; Laban, Lawrence, 1974).

Надежность систем также различается: некоторые системы, такие как FACS и BAP, прошли эмпирическую оценку надежности, тогда как другие, такие как LMA, были оценены в ограниченной степени, и существуют системы, надежность которых вообще не была оценена (Bernardet et al., 2019; Dael et al., 2012; Ekman, Friesen, 1978; Laban, Lawrence, 1974; Shafir et al., 2016).

Таким образом, различия между системами классификации, кодирования и интерпретации движений включают их целевое назначение, происхождение, степень субъективного вывода, фокус на качестве или типе движения, уровень детализации, время кодирования и надежность. М. Карг с соавторами (Karg et al., 2013) подчеркивают, что движения обычно представляются траекториями углов суставов или кинематическими признаками, которые, хотя и детализированы, могут быть вычислительно затратными, а также могут игнорировать качества выразительности движений. Системы нотации движений предлагают более эффективное и выразительное представление.

В связи с концептуальной близостью к нашей системе нотации, мы уделяем особое внимание системе Common Morphokinetic Alphabet (CMA) для транскрипции и анализа движений тела, которая стремится обеспечить комплексный, точный и удобный метод записи физических движений, устанавливая грамматические правила на основе фразовой грамматики Ноама Хомского (Izquierdo, Anguera, 2018). Как и наша нотация, система CMA включает принципы лингвистики, особенно структуру и синтаксис фраз движений, для создания системы нотации, способной захватить сложность человеческого движения в трехмерном пространстве во времени (Izquierdo, Anguera, 2018). Система CMA основана на предыдущих системах, таких как кинесическая система записи движений Рэя Бёрдвистелла (KNS) (Birdwhistell, 1952) и система кодирования лицевых действий (FACS) (Ekman, Friesen, 1978), но, в отличие от них, эта система позиционирует себя как более комплексную и адаптируемую систему, способную идти в ногу с технологическими достижениями (Izquierdo, Anguera, 2018).

Следует подчеркнуть, что исследования, проведенные Izquierdo, Anguera (2018), очень тесно связаны с нашей работой в некоторых аспектах, которые будут обсуждены в следующем разделе.

Методология.

Система нотации движений в нашем понимании должна удовлетворять нескольким ключевым критериям.

Нотация движений должна должна быть семантико ориентированной, основанной на естественном языке. В этом случае предметный эксперт на этапе написании формулы движения (или ее чтении) представлял бы, как будет совершаться действие.

Язык записи движений должен быть представлен в виде формализованной структуры понятий и правил их реализации. Это позволит использовать компьютерные технологии, в частности, чтение интеллектуальным интерпретатором закодированного сообщения.

Язык для записи движений должен быть гибким, расширяемым за счет внедрения новых объектов, понятий и правил, а также легко адаптируемым к возможности изменения параметров движения.

Нотация должна обладать полнотой (охватыванием всех аспектов движения) и универсальностью (способность кодировать все виды движений)

Нотация должна обладать анатомической и физиологической точностью (правильным представлением механики тела).

Должна существовать возможность количественной оценки создаваемых моделей движения.

Кроме того, нотация должна быть практичной и легко интегрируемой с современными технологиями. Также важно, чтобы система нотации могла документировать наблюдаемые движения, не полагаясь на контекстуальные предположения или субъективные интерпретации, чтобы обеспечить объективность и минимизировать предвзятость кодировщиков. Мы постарались максимально учитывать эти критерии при создании нашей системы нотации движений.

В отличие от других систем нотации движений, в частности системы CMA (Izquierdo, Anguera, 2018), которая наиболее близка к нашей, где нотация движения включает не только положение/состояние, но и комплексные модели движений (например, руки вместе), и где наблюдаются повторения сущностей (например, правая и левая стороны для положения и частей тела), а некоторые индикаторы описываются цифрами, наша система нотации моделирует движение как последовательный переход от одного неподвижного состояния части тела, выполняющего движение, к другому неподвижному состоянию. Таким образом ключевое отличие в описании движения – вместо описания самого движения, требующее внедрения многочисленных переменных, мы задаем только начальное и конечное состояния части тела, выполняющего движение (можно включать и промежуточные состояния, об этом ниже), а также временные характеристики исполнения самого движения как перехода от одного состояния части тела к другому его состоянию.

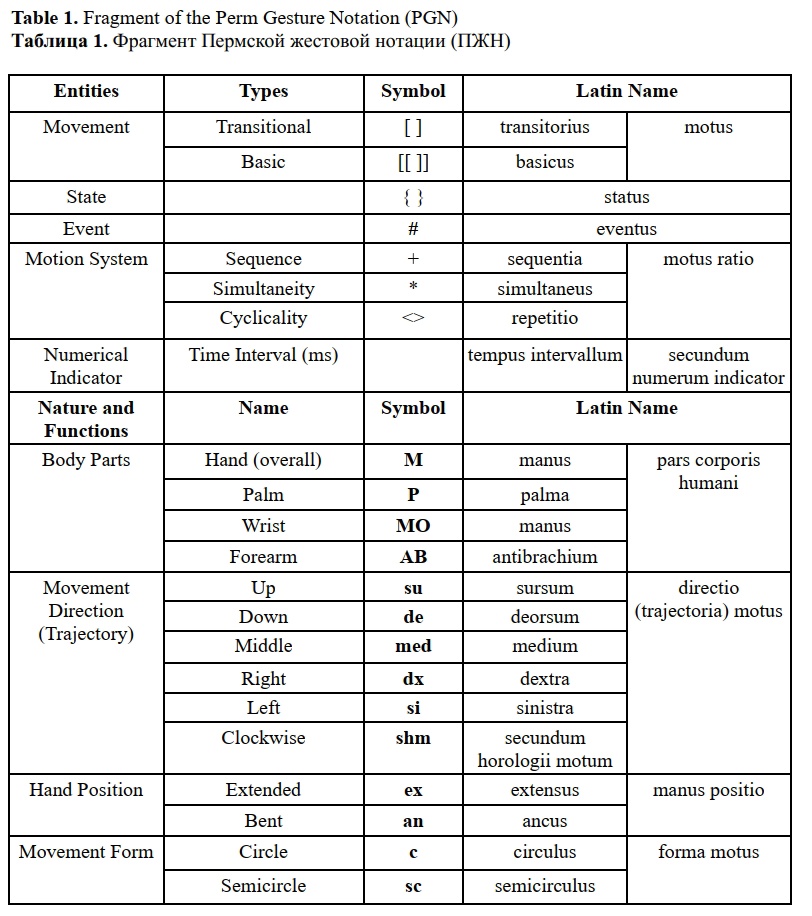

Каждое состояние имеет конкретные индикаторы, связанные с определенными сущностями (система движения, числовые индикаторы и т.д.), частями тела, и их природой и функциями. Сущности, природа и функции частей тела имеют различные типы, что позволяет представлять их в структурированной и символьной форме. Латинский язык выбран как естественный язык описания. Фрагмент системы приведен в таблице 1.

Нотация позволяет описывать как движение целиком, так и фрагменты движения. Пример формулы движения с использованием нашей нотации:

:1000:{  } (1)

} (1)

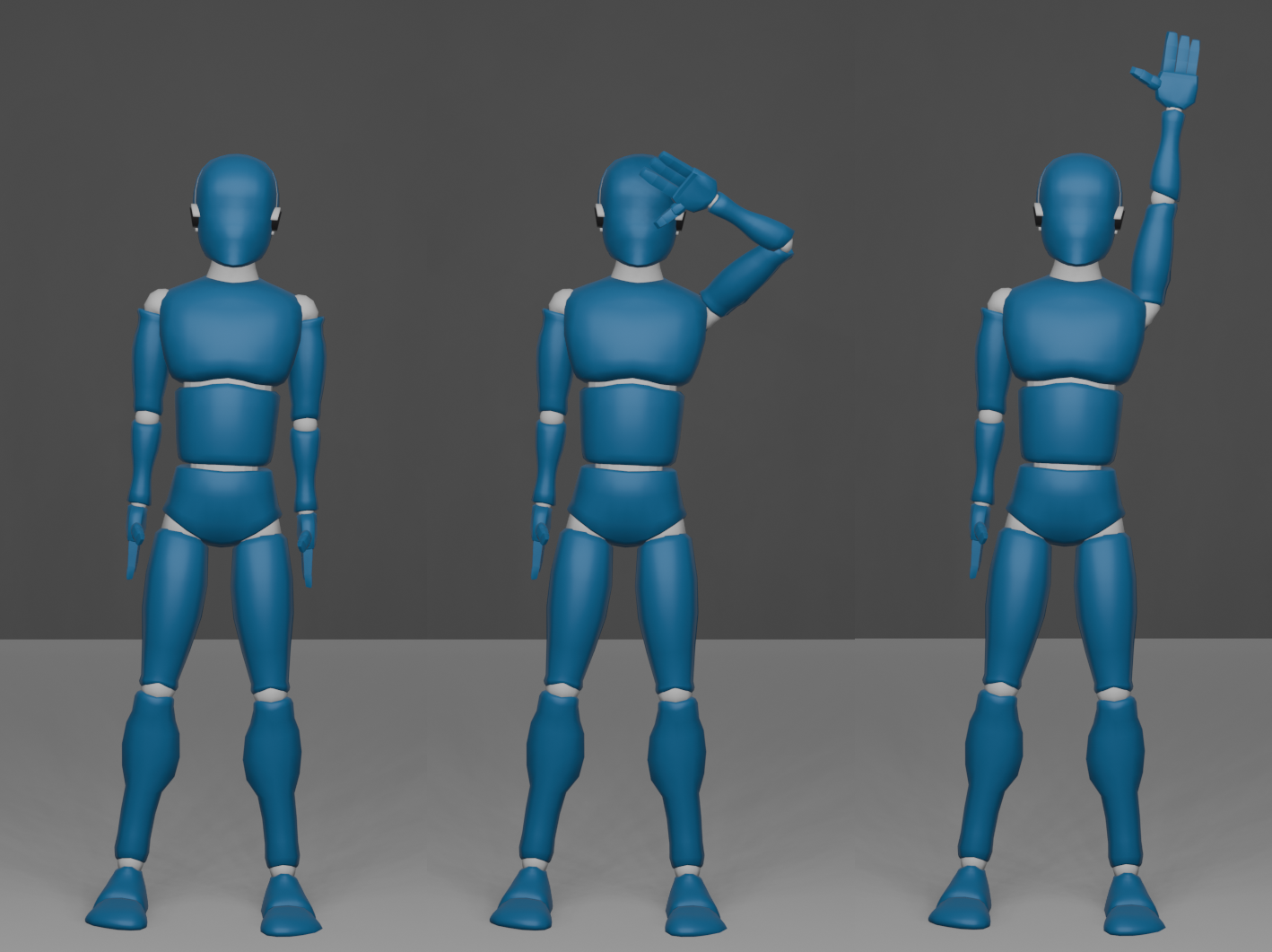

Описание движения с использованием конкретной системы нотации можно проиллюстрировать на примере поднятия руки, как показано на рисунке 1. Для точного описания состояния части тела используется следующая модель (демонстрируется для левой руки):

● М (manus) – обозначает руку/кисть

● Левый нижний индекс (si): Указывает выбор руки, где "si" означает левую руку (аналогично, "dx" означает правую руку).

● Правый верхний индекс (ex): Указывает положение руки, где "ex" обозначает вытянутую руку.

● Правый нижний индекс (de): Обозначает направление, где "de" означает вниз.

Использование фигурных скобок {} вокруг нотации указывает на то, что эта часть движения является состоянием, а :1000: указывает на продолжительность этого состояния в миллисекундах. Таким образом формула (1) передает начальное состояние выполнения движения.

Это можно перевести в более привычную для машины форму, что приведет к:

:1000:{_si_M^ex_de} (2)

Некоторые положения и состояния руки предполагаются по умолчанию, в частности, состояние полностью вытянутой руки считается по умолчанию. Следовательно, такие состояния могут явно не отмечаться в нотации. Поэтому (2) упрощается до:

:1000:{_si_M_de} (3)

Используя эти правила нотации, мы можем описать движение, показанное на рисунке 1, следующим образом:

:1000:{si_M_de}:1000:[si_M_su]:1000:{RE} (4)

Из этой формулы очевидно, что она не описывает промежуточные состояния: движение левой руки переходит непосредственно из положения руки, вытянутой вниз, в положение руки, вытянутой вверх. Может показаться, что в формуле отдельно описывается движение (например, тут: 1000:[si_M_su]). Однако это не так: здесь фиксируется конечное состояние результата движения, а размещение его в части кода, обозначающего движение нужно для того, чтобы а) обозначить само движение, б) время его выполнения и в) возможности одновременного исполнения с другим действием (пример дан ниже). В то же время поскольку конечное состояние уже представлено в формуле, нет смысла дублировать его запись, поэтому формула завершается фрагментом 1000:{RE}, указывающим на то, что это состояние, длящееся 1000 мс, обозначено в блоке движения, т.е. является {si_M_su}.

Рисунок 1. Поднятие руки в приложении Blender (три среза движения)

Figure 1. Raising the Arm in Blender (three motion slices)

В этом случае движение выполняется наиболее эффективным образом. Однако, если мы хотим выполнить это движение иначе, нам нужно определить промежуточные состояния для положения руки. Это приведет к тому, что рука будет двигаться по другой траектории. Например, поднятие руки через промежуточное положение, где рука вытянута в сторону, и затем пауза на 1 миллисекунду (1:{RE} обозначает состояние покоя на 1 миллисекунду), можно описать следующим образом:

:200:{si_M_de}:1000:[si_M_si]:1:{RE}:1000:[si_M_su]:200:{RE}

Рисунок 2. Поднятие руки в приложении Blender (четыре среза движения)

Figure 2. Raising an arm in Blender (four motion slices)

На рисунке 2 видно, что конечное положение руки совпадает с положением, показанным на рисунке 1: рука оказывается вытянутой с ладонью, обращенной вперед. Чтобы указать другое конечное положение, нам нужно использовать дополнительную нотацию для уточнения точной ориентации. Например:

:200:{si_M_de}:1000:[si_M_si]:1:{RE}:1000:[si_M_su*MO_dx_]:200:{RE}

Разберем конструкцию [si_M_su*MO_dx_]:

● Указывается конечное положение левой руки (вверх).

● Знак ‘*’ обозначает одновременность, то есть другое действие происходит одновременно с положением руки вверх.

● “MO” представляет ладонь, а “dx” указывает, что ладонь повернута вправо. Для левой руки это означает, что ладонь повернута к телу.

Этот пример иллюстрирует, что направления и положения частей тела, описанные в таблице 1, могут быть применены к различным частям тела в зависимости от их анатомических возможностей. Например, для ладони “MO_at” (вперед) означает поворот руки так, чтобы ладонь была обращена вперед. Таким образом, положение руки в ее конечном состоянии, как показано на рисунках 1 и 2, может быть точно описано с использованием этой системы нотации.

Так как нотация предназначена для моделирования движений компьютеризированными системами, в них есть предустановленные настройки (конфигурации), по которым осуществляется действие частей тела антропоморфной 3D-модели. Например, поднятие руки вверх производится через промежуточное состояние сгиба руки в локте, поэтому такое движение не требует специального маркирования. В то же время такой подход ставит проблему наиболее адекватных человеческим движениям настроек, которые могут быть получены с помощью статистического анализа множества моделируемых движений людей с разными психо-биологическими характеристиками (например, возраст, пол, темперамент и др.), что является перспективой исследования.

До сих пор описание движений проводилось на примере одной части тела; но как нотация работает с одновременным движением нескольких частей тела, например, обеих рук?

Для моделирования симультанно-сукцессивных движений (одновременного исполнения действий несколькими частями тела в их временной динамике) вводятся следующие понятия:

1. Независимость (автономность) частей тела 3D-модели, ограниченная только анатомическими и физиологическими возможностями человека, зафиксированными в настройках 3D-модели.

2. «Дорожки записи», с помощью которых осуществляется независимое описание движения каждой части тела (для каждой части тела вводится своя «дорожка»).

3. Событие движения, под которым понимаем а) любое изменение состояния/движения части тела, вызванное внешними причинами (другой частью тела или предметом – например, столкновением руки с другой частью тела или предметом) или б) комплексное движение частей тела, при котором задаются обязательные состояния этих частей относительно друг друга во времени. Отдельно следует отметить, что, несмотря на автономность движения части тела, его движение может в силу связанности и инерционности оказывать влияние на другую часть тела (например, поворот руки связан с поворотом корпуса). Такие инерционные изменения естественны и не являются событиями.

Событие привязано ко времени, но происходит в пределах некоторого выделенного промежутка Δt. Параметры Δt можно использовать для расчета и оценки точности моделируемых движений. Событие обозначаем символом “#” в верхнем левом индексе части тела, например, описание события (#1) контакта двух рук перед грудью: для левой руки [_si_^#1^M_dx*at_] и для правой [_dx_^#1^M_si*at_]. События имеют свои индексы, что позволяет отличать одно событие от другого и сопоставлять фрагменты формулы, описывающие разные части тела.

Отдельно отметим, что комплексные движения (как например, «руки вместе» в CMA), в нашем случае могут быть определены отдельно и храниться в виде вариантов формулы. Иными словами те ли иные паттерны состояний или движений могут быть реализованы в виде единиц некоего словаря со своими возможными формальными представлениями.

Реализация системы управления движением

Разработка системы управления движением, основанной на лингвистической нотации проходит несколько этапов: нотацию жестов, построение внутреннего представления движения и его перевод в исполняемые движения, демонстрируемые с использованием программ для 3D-моделирования и анимации.

Первый этап – разбор нотации (парсинг формулы). Парсинг включает разбор строки нотации, выделение термов и создание абстрактного синтаксического дерева (AST). Покажем процесс парсинга на примере разбора формулы: :400:{_dx_M_2la-de-2at_}:500:[_dx_M_la-su-2at_]:400:{RE}

1. Выделение отдельных термов:

- Первыйтерм: :400:{_dx_M_2la-de-2at_}

○ Время: 400 миллисекунд.

○ Тип: состояние ({}).

○ Детали положения:

■ dx_M: правая рука.

■ 2la: движение влево с коэффициентом 2.

■ de: движение вниз.

■ 2at: движение вперед с коэффициентом 2.

○ Объект терма: Создается State Term с атрибутами:

■ time = 400.

■ node = dx_M.

■ details = {‘2la’, ‘de’, ‘2at’}.

- Второй терм: :500:[_dx_M_la-su-2at_]

○ Время: 500 миллисекунд.

○ Тип: движение ([]).

○ Детали направления (конечное состояние):

■ dx_M: правая рука.

■ la: движение влево.

■ su: движение вверх.

■ 2at: движение вперед с коэффициентом 2.

- Объект терма: Создается Move Term:

■ time = 500.

■ node = dx_M.

■ details = {‘la’, ‘su’, ‘2at’}.

- Третий терм: :400:{RE}

○ Время: 400 миллисекунд.

○ Тип: состояние ({}).

○ Детали: RE (фиксация состояния).

○ Объект терма: Создается State Term:

■ time = 400.

■ details = {‘RE’}.

Второй этап – построение внутреннего представления движения. На основе AST строится внутреннее представление движения, состоящее из серии кадров. Эти кадры содержат информацию о том, какая кость (часть тела) исполнителя относится к ним, как они влияют на его положение и конкретный момент времени с начала движения, когда этот кадр актуален. В этой серии записываются только ключевые кадры – крайние положения примитивных движений. Например, если исполнителю нужно обвести букву “L” рукой, в серии будут включены ключевые кадры для положений руки внизу, вверху и вверху справа. Интерполяция движения является обязанностью исполнителя.

Третий этап – преобразование внутреннего представления в конечное движение. Внутреннее представление движения передается исполнителю, который преобразует его в конечный результат, видимый пользователю. Исполнителем может быть робот или любая программа, работающая со скелетной анимацией, включая игровые движки. В этом исследовании в качестве исполнителя используется Blender 3D, программа для 3D-моделирования и анимации. Blender 3D позволяет создавать пользовательские дополнения с использованием Python и предоставляет обширный набор готовых графических интерфейсов и программных утилит для работы с 3D-графикой.

Результаты и обсуждение

В данной статье в качестве результатов мы рассматриваем демонстрацию возможностей нотации описывать естественные движения человека, взятые из фрагментов видеозаписей мультимодального корпуса описания людьми различных эмоциональных состояний. В данном случае реализуется основное назначение разрабатываемой жестовой нотации – служить целям создания бесшовных инструментов перехода от одной формы человеческой активности к другой в различных интерфейсно-опосредованных коммуникациях с помощью универсальной и точной системы для кодирования и описания движений человека, включая жесты, позы и сложные взаимодействия частей тела.

На данном этапе мы не ставим задачи полного и точного темпо-ритмического и пространственного воспроизведения машиной движений человека в силу имеющихся на сегодняшний день технических проблем. Поэтому сразу обозначим рамки формального описания: нотация будет осуществляться только для движений рук.

Комплекс движений описывается как совокупность состояний для каждой руки, представленных в двух записях (т.н. дорожках). В формальной записи переход от одной дорожки к другой отделяетсязапятой (данный знак используется только в этой функции).

Производимая формальная запись движения, в конечном счете, сформировало и наше понимание жеста, который с точки зрения семантики коммуникативно направлен и семантически целостен, а с точки зрения формы представляет собой движение от одного состояния до другого (включая промежуточные состояния прохождения движения, если они были).

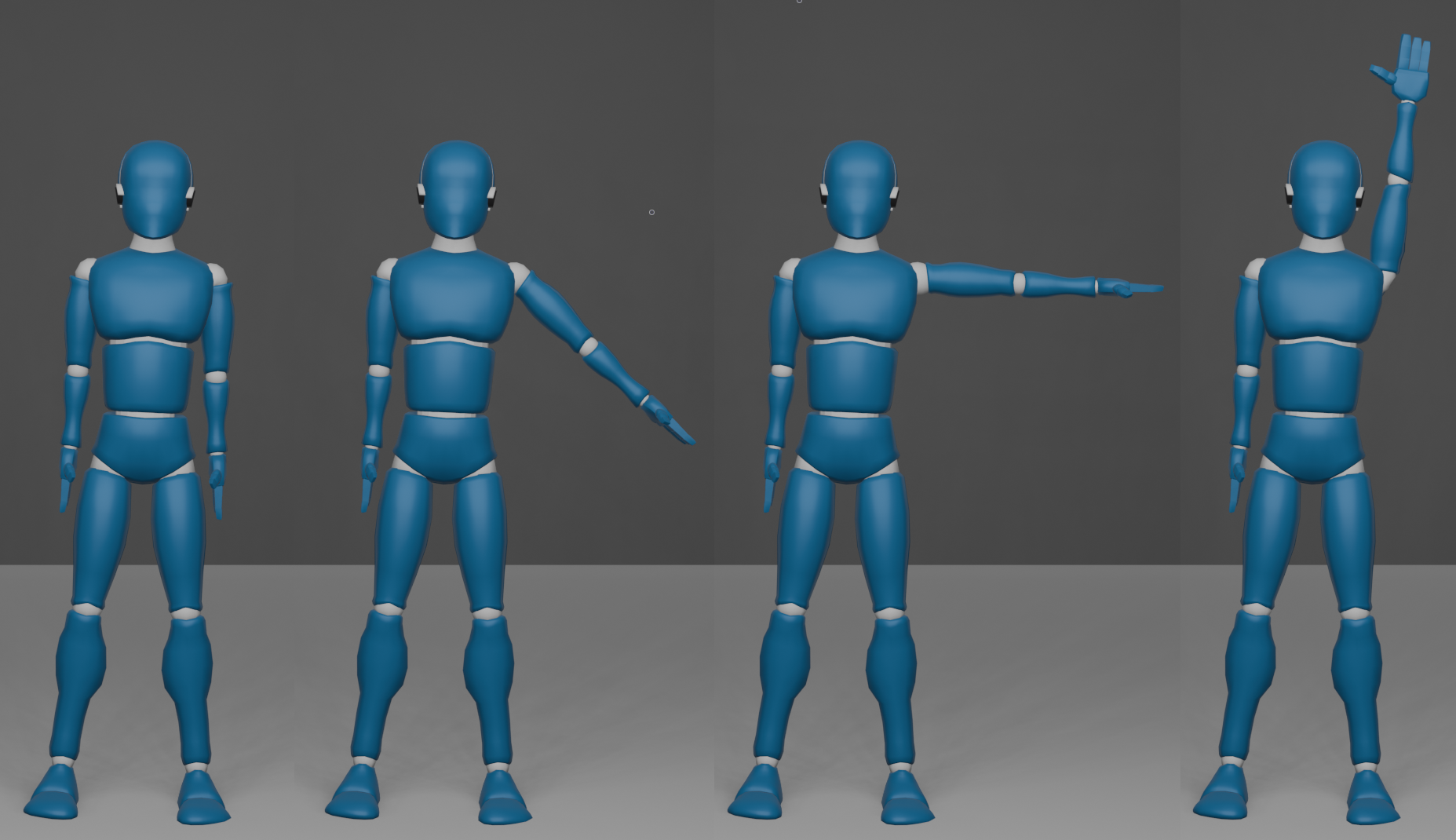

Рассмотрим фрагменты движений из специализированного мультимодального корпуса эмоций и жестов. Эмоции в данном корпусе условно можно поделить на положительные и отрицательные. Количественные и качественные характеристики движений, сопровождающих эти эмоции, могут варьироваться. В качестве примера рассмотрим два комплекса движений: один, используемый в контексте положительной эмоции “Восторг” (рисунок 3), и другой, сопровождающий отрицательную эмоцию “Злость” (рисунок 4), а также соответствующие языковые контексты их применения (см. пример 1 и пример 2). В качестве иллюстрации будут использоваться скриншоты состояний движения рук информантов, которые служат для модельного представления в виде формул движения.

Каждый из представленных комплексов движений, выбранных нами для иллюстрации, отличается рядом параметров. В отношении первого комплекса, который встречается в контексте эмоции «Восторг», следует отметить его упрощенную структуру. Кроме того, данное движение является примером синхронного движения обеих рук.

Figure 3. Illustration of the complex of movements within the framework of the emotion “Delight” and its components.

Рисунок 3. Иллюстрация комплекса движений в рамках эмоции «Восторг» и его составляющие.

а) б) в)

Данный комплекс движений наблюдается в следующем языковом контексте:

Пример 1. …И вот (Согнутые руки сложены одна ладонь на тыльную сторону ладони другой руки) полет на параплане (Разведение рук в разные стороны вниз), я была в восторге (Поднятые по разным сторонам согнутые руки)...

При описании эмоции «Восторг» информант использует этот комплекс движений (Рисунок 3), который можно разделить на три основных состояния: а) руки согнуты и сложены ладонь на тыльную сторону ладони; б) разведение рук в стороны вниз; в) поднятые по разные стороны согнутые руки.

При детализированном описании этих состояний можно выделить следующие характеристики: начальное состояние (а)) представляет собой исходное положение, в котором руки согнуты в локтях под углом 90 градусов, левое предплечье направлено вперед и вправо, правое – вперед и влево, ладони сложены одна на другую на уровне живота (ладони вверх). Данный компонент можно представить в виде термов ({_dx_B_de_+dx_AB_ad-at-si_}и{_si_B_de_+si_AB_ad-at-dx_}). В состоянии (б)) правая рука вытянута вниз и вправо, левая – вниз и влево ([_dx_AB_de-la_] и [_si_AB_de-la_]). Наконец, последное состояние (в)), являющееся завершающим этапом комплекса, характеризуется тем, что правая рука согнута, с предплечьем, направленным вверх и вправо, и левая рука также согнута, с предплечьем, направленным вверх и влево ([_dx_AB_su-la_] и [_si_AB_su-la_]). За каждой частью компонента, обозначающего движение, следует фиксация с конкретным измерением времени, например, (:190:{RE})

Этот комплекс движений может быть закодирован четко в виде следующей формулы:

:415:{_dx_B_de_+dx_AB_ad-at-si_}:375:[_dx_AB_de-la_]:765:{RE}:690:[_dx_AB_su-la_]:190{RE},:415:{_si_B_de_+si_AB_ad-at-dx_}:375:[_si_AB_de-la_]:765:{RE}:690:[_si_AB_su-la_]:190:{RE}

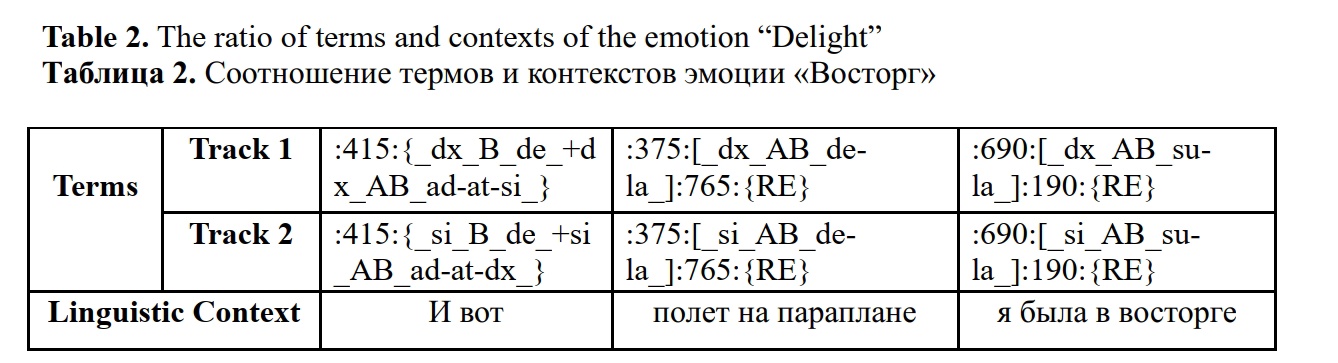

Структура данной формулы состоит из шести термов, по три для каждой руки. Эти термы распределены по двум дорожкам, по одной для правой и левой руки соответственно. При сравнении термов и их последовательности в обеих дорожках можно отметить их полную идентичность, что указывает на синхронность движений обеих рук. Кроме того, каждый терм можно соотнести с определенным языковым контекстом, что наглядно представлено в таблице 2.

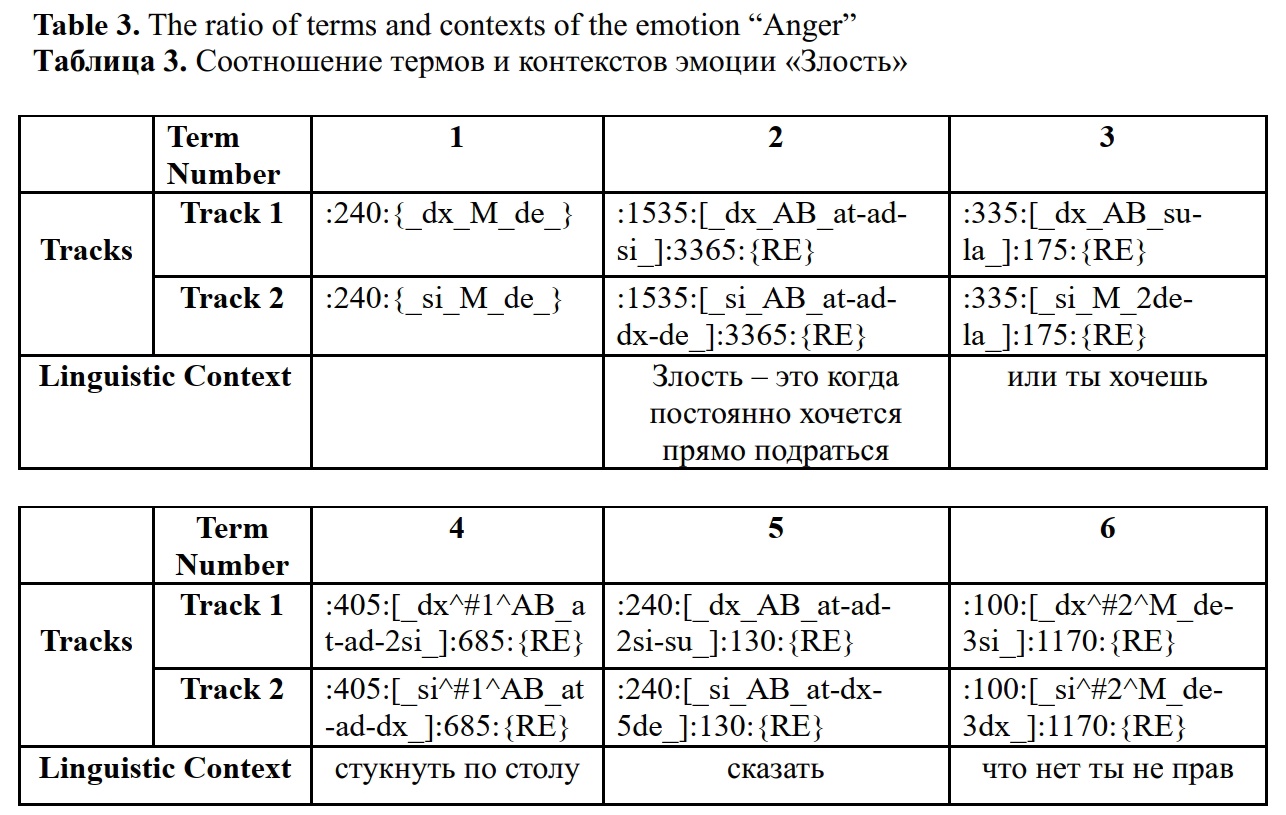

Далее излагается иллюстрация комплекса движений, сопровождающих отрицательную эмоцию «Злость».

Figure 4. Illustration of the complex of movements within the framework of the emotion “Anger” and its components.

Рисунок 4. Иллюстрация комплекса движений в рамках эмоции «Злость» и его составляющие.

Что касается комплекс движений в рамках эмоции «Злость», то он сопровождает следующий языковой контекст:

Пример 2. (Обе руки опущены вниз) Злость – это когда постоянно хочется прямо подраться (Руки согнуты, предплечья правой и левой рук поднимаются вверх исходятся – правое влево, левое вправо) или ты хочешь (Правая рука согнута, предплечье вверх, левая рука вытянута вниз и немного в бок) стукнуть по столу (Согнутые руки сложены одна ладошка в кулак на другую), сказать (Правая рука согнута, предплечье правой руки влево и немного вверх, левая рука вытягивается вперед, вправо, опускается вниз с пятерной амплитудой) , что нет (Руки вытянуты вниз и расходятся – правая влево, левая вправо и пересекаются), ты не прав…

Интерпретация движений в данной последовательности в отличие от предыдущей, – сложней, поскольку включает несинхронизированные и дополнительные действия для правой (dx) и левой (si) руки, структурированные по термам, в двух основных дорожках.

Для правой руки движение начинается с исходного положения, в котором рука опущена вниз ({_dx_M_de_}). Далее следуют несколько компонентов. Второй компонент (б)) ([_dx_AB_at-ad-si_]) проявляется, когда предплечье правой руки вытягивается вперед, сгибается к плечу и движется влево, после чего происходит фиксация конечного положения ({RE}). Дальше следует третий компонент (в)) – предплечье поднимается вверх и движется влево ([_dx_AB_su-la_]), за чем также следует фиксация ({RE}).

Далее происходит первое событие (г) ([_dx^#1^AB_at-ad-2si_]), когда предплечье вытягивается вперед, сгибается к плечу и движется влево с удвоенной амплитудой. После фиксации положения (:200:{RE}) сталкиваемся со следующим компонентом (д)) ([_dx_AB_at-ad-2si-su_]), где предплечье снова вытягивается вперед, сгибается к плечу, движется влево с удвоенной амплитудой и поднимается вверх. Этап завершается фиксацией ({RE}). Последное событие (е)) включает опускание руки вниз и движение влево с утроенной амплитудой ([_dx^#2^M_de-3si_]), с последующей фиксацией ({RE}).

Левая рука повторяет схожую последовательность движений. В исходном положении (а)) она также опущена вниз ({_si_M_de_}). Следующий компонент (б)) включает вытягивание предплечья вперед, сгибание к плечу, движение вправо и опускание вниз на ([_si_AB_at-ad-dx-de_]), после чего фиксируется положение ({RE}). Дальше (в)) предплечье опускается вниз с удвоенной амплитудой и движется влево ([_si_M_2de-la_]), с фиксацией ({RE}).

Первое событие (г)), в течение которого предплечье вытягивается вперед, сгибается к плечу и движется вправо, можно отметить как ([_si^#1^AB_at-ad-dx_]), с последующей фиксацией ({RE}). Затем следует компонент движения (д)), где предплечье вытягивается вперед, движется вправо и опускается вниз с пятерной амплитудой ([_si_AB_at-dx-5de_]), после чего положение фиксируется ({RE}). Последнее событие (е)) включает опускание руки вниз и движение вправо с утроенной амплитудой ([_si^#2^M_de-3dx_]), завершающееся фиксацией ({RE}).

Общее описание данного комплекса движений с учётом их временного диапазона можно кодировать следующим образом:

:240:{_dx_M_de_}:1535:[_dx_AB_at-ad-si_]:3365:{RE}:335:[_dx_AB_su-la_]:175:{RE}:405:[_dx^#1^AB_at-ad-2si_]:685:{RE}:240:[_dx_AB_at-ad-2si-su_]:130:{RE}:100:[_dx^#2^M_de-3si_]:1170:{RE},:240:{_si_M_de_}:1535:[_si_AB_at-ad-dx-de_]:3365:{RE}:335:[_si_M_2de-la_]:175:{RE}:405:[_si^#1^AB_at-ad-dx_]:685:{RE}:240:[_si_AB_at-dx-5de_]:130:{RE}:100:[_si^#2^M_de-3dx_]:1170:{RE}

Исходя из представленной формулы, можно отметить, что рассматриваемая последовательность представляет собой сложный комплекс движений рук, который включает в себя не только элементарные манипуляции, но и более сложные формы взаимодействия между руками, что свидетельствует о высоком уровне сложности координации и синхронизации движений в данной последовательности. Таким образом, можно подчеркнуть, что предлагаемая жестовая нотация представляет собой эффективный инструмент для систематизации и отображения не только примитивных, но и таких сложных движений. Данная нотация позволяет адекватно и детально фиксировать любые жестовые взаимодействия, что обеспечивает точное представление их структуры и последовательности.

Представленные в таблицах 2 и 3 нотации фрагментов речежестового поведения можно обогатить дополнительными параметрами, первая часть из которых представляет собой динамически изменчивые параметры поведения, основанные, во-первых, на уже обозначенных параметрах (последовательности термов формулы, речевой материал, время протекания жестов), во-вторых, включающие метрики, выводимые из этих параметров, и в-третьих, факультативные физиологические характеристики, которые можно измерять в экспериментальной ситуации (пульс, объем дыхания, сатурация и др.), а вторая часть состоит из факультативных постоянных (для протекающей коммуникации) характеристик, описывающих социально-демографические, психологические и физиологические параметры человека (пол, возраст, образование, рост, размах рук и др.).

Построение иерархии метрик для анализа жестов и их ограничений опирается на обширные исследовательские материалы. В ряде работ последних лет (Liu et al., 2022; Qi et al., 2024; Tonoli et al., 2024; Yang et al., 2023; Yoon et al., 2020; Zhi et al., 2023) обсуждаются такие метрики, как Mean Squared Error (MSE), Mean Average Error (MAE), Fréchet Gesture Distance (FGD), Gesture Area Coverage (GAC) и др., которые сравнивают движения с эталоном, оценивают естественность и схожесть движений, анализируют динамические характеристики (скорость, ускорение и др.) и учитывают пространственное покрытие жестов.

Полагаем, что некоторые метрики могут быть использованы и в нашем случае для оценки речежестового поведения. При этом мы исходим из того, что поскольку интегральной поведенческой единицей в нашем случае является терм (как конечное состояние движения, которое в нотации может быть представлено переходом от предыдущего состояния к последующему посредством движения, т.е. как {termK} → [termK+1]), то все измерения должны быть привязаны к термам. Из такого подхода следуют некоторые метрики:

1. L – длина траектории движения руки. Здесь и в дальнейшем вычисления можно проводить как для фрагмента (termK → termK+1), так и для всей цепочки движения одной руки или двух рук: term1 → term2 →… → termN.

2. S – площадь под кривой траектории движения руки или рук в рамках одного жеста, т.е. выделенной поведенческой единицы termK → termK+1 и всего движения.

3. V – объем захваченного жестом (termK → termK+1) пространства. Здесь могут быть разные методики измерения: от пространства жеста одной руки или двух рук до пространства, рассматриваемого в жесте между двумя руками.

Параметры L, S, V при описании реальной коммуникации (без использования 3D-моделей) нуждаются в нормировании; мы предлагаем ввести нормирующий параметр  , где (l1 – рост, l2 – размах рук) для L, N2 для S и N3 для V.

, где (l1 – рост, l2 – размах рук) для L, N2 для S и N3 для V.

4. speech – объем речевого материала, привязанного ко времени произведения жеста, т.е. к termK → termK+1.

5.  – метрика, характеризующая динамику изменения захваченного жестами пространства:

– метрика, характеризующая динамику изменения захваченного жестами пространства:  . Метрика temp может вычисляться иначе, например, как отношение количества термов или количества речевого материала к единице времени.

. Метрика temp может вычисляться иначе, например, как отношение количества термов или количества речевого материала к единице времени.

В целом, запись аргументов функции Behavior можно представить следующим образом:

Behavior = {(term1, speech1, t1, L1, S1, V1, …),..., (termN, speechN, tN, LN, SN, VN, …); (pulse1, tidal volume1, ...)*, ..., (pulseN, tidal volumeN, ...)*; (gender, age, N, temp...)*}, гдезнаком * отмеченыгруппыфакультативныхпараметров.

Заключение

Создание формализованной системы кодирования движений человека для интерфейсно-опосредованной коммуникации в различных машинно-генерируемых средах, как мы попытались показать, является сложной, но решаемой научной проблемой. В ходе проведенного исследования была представлена система Пермской жестовой нотации и выделена единица описания поведения человека – терм, представляющий запись перехода от предшествующего фиксированного состояния части тела в рамках его движения к последующему фиксированному состоянию. Терм как единица дискретизации движения выравнивает относительно себя и другие формы активности (т.е. выступает как единица когнитивно-поведенческая), в качестве которых можно рассматривать речь (мы говорили об объеме речевого материала, хотя могут быть и иные измеряемые параметры, например, акустические), а также мимику или данные носимых устройств, передающих сведения о пульсе, объеме дыхания и др.

Исходя из того, что вероятно, каждое движение человека имеет семантику, т.е. не является случайным и/или хаотическим в последовательности актов человеческого поведения, мы должны в пределе требовать от машины такой же семантизации двигательной активности и синхронизации ее с речевой семантикой сообщения. Полное и точное темпо-ритмическое и пространственное воспроизведение машиной движений человека (т.е. по сути копирование хронотопа человека его виртуальным аватаром) возможно с помощью обращения к комбинированию методов и технологий компьютерного зрения с современными нейросетевыми моделями-трансформерами. Конечной целью такого подхода является генерация формулы движения в разработанной формально-языковой нотации на основе анализа поступающего на вход модели видеоряда движений человека. Сгенерированная формула может затем передаваться исполнителю (виртуальной 3D-модели или физическому роботизируемому устройству). Воспроизведение закодированных в формуле движений исполнителем нужно в том числе и для анализа точности и реалистичности сгенерированных анимаций путём сравнения с реальными движениями с последующими корректировкой формулы и дообучения модели.

Очевидно, что качество воспроизведения модели речежестового поведения человека машиной в конечном счете должно оцениваться самим человеком. Важно, чтобы машины не просто повторяли физические движения, но и адекватно передавали семантические и эмоциональные значения этих движений, соответствующие человеческим ожиданиям и культурным нормам. В этом контексте появляется запрос к созданию отдельной ветви общей семантики – техносемантики как семантики, генерируемой антропоморфными машинами в процессе человеко-машинного взаимодействия и адресованной коммуницирующему с машиной человеку (о части проблем техносемантики см. [Belousov et al., 2024]).

Синтез движений, который ориентирован не только на механическое воспроизведение, но и в перспективе – на смысловое содержание, является важной составляющей в создании более эффективных и человекоцентричных систем коммуникации в различных машинно-генерируемых средах. При этом важно учитывать не только визуальные и кинематические параметры, но и скрытые смыслы, которые несут жесты и движения в контексте общения. Эта задача становится все более актуальной в условиях развития антропоморфных машин и больших языковых моделей, которые стремятся не просто подражать человеку, но и коммуницировать с ним на уровне, близком к человеческому.

В заключение отметим, что дальнейшее развитие систем кодирования движений, в том числе и представленной в данной работе, и применение их в различных областях, таких как киноиндустрия, компьютерные игры, образование, медицина, спорт и робототехника, могут стать основой для новых форм коммуникации, в которых машины не просто выполняют команды, но и активно участвуют в семантически значимых взаимодействиях, поддерживая полноценный и интуитивный диалог с человеком.

Список литературы

Abbie M. Movement notation // The Australian journal of physiotherapy. 1974. Vol. 20 (2). Pp. 61–69. https://doi.org/10.1016/S0004-9514(14)61177-6

Bashan M., Einbinder H., Harries J., Shosani M., Shoval D. Movement Notation: Eshkol and Abraham Wachmann. Köln: Verlag der Buchhandlung Walther König, 2024.

Belousov K. I., Sazina D. A., Ryabinin K. V., Brokhin, L. Yu. Sensory Technolinguistics: On Mechanisms of Transmitting Multimodal Messages in Perceptual-Cognitive Interfaces // Automatic Documentation and Mathematical Linguistics. 2024. Vol. 58, Issue 2. Pp. 108–116. https://doi.org/10.3103/s0005105524700079

Benesh R., Benesh J. An Introduction to Benesh Dance Notation. London: A & C Black, 1956.

Bernardet U., Fdili Alaoui S., Studd K., Bradley K., Pasquier P., Schiphorst, T. Assessing the reliability of the Laban Movement Analysis system // PLoS ONE. 2019. Vol. 14 (6): e0218179. https://doi.org/10.1371/journal.pone.0218179

Birdwhistell R. L. Introduction to Kinesics: An Annotation System for Analysis of Body Motion and Gesture. Washington, DC.: Foreign Service Institute, 1952.

Bull P., Doody J. P. 8 Gesture and body movement. De Gruyter eBooks, 2013. Pp. 205–228. https://doi.org/10.1515/9783110238150.205

Calvert T. Approaches to the Representation of Human Movement: Notation, Animation and Motion Capture // Dance Notations and Robot Motion, Springer Tracts in Advanced Robotics. 2015. Pp. 49–68. https://doi.org/10.1007/978-3-319-25739-6_3

Dael N., Mortillaro M., Scherer K. R. The Body Action and Posture Coding System (BAP): Development and Reliability // Journal of Nonverbal Behavior. 2012. Vol. 36 (2). Pp. 97–121. https://doi.org/10.1007/s10919-012-0130-0

Dell C. A Primer for Movement Description: Using Effort-shape and Supplementary Concepts. New York: Dance Notation Bureau Press, 1977.

Duprey S., Naaim A., Moissenet F., Begon M., Chèze, L. Kinematic models of the upper limb joints for multibody kinematics optimisation: An overview // Journal of Biomechanics. 2017. Vol. 62. Pp. 87–94. DOI: 10.1016/j.jbiomech.2016.12.005

Ekman P., Friesen W. V. Facial Action Coding System. Palo Alto, CA: Consulting Psychologists, 1978.

El Raheb K., Ioannidis Y. From dance notation to conceptual models: a multilayer approach // Proceedings of the 2014 International Workshop on Movement and Computing, MOCO, ACM. New York, 2014. Pp. 25–30.

El Raheb K., Buccoli M., Zanoni M., Katifori A., Kasomoulis A., Sarti A., Ioannidis Y. Towards a general framework for the annotation of dance motion sequences // Multimed Tools Appl. 2023. Vol. 82. Issue 3. Pp. 3363–3395. https://doi.org/10.1007/s11042-022-12602-y

Eshkol N., Wachmann A. Movement Notation. London: Weidenfeld and Nicolson, 1958.

Farnell B. M. Movement Notation Systems // The World’s Writing Systems / ed. Peter T. Daniels. Oxford University Press, 1996. Pp. 855–879.

Frishberg N. Writing systems and problems for sign language notation // Journal for the Anthropological Study of Human Movement. 1983. Vol. 2 (4). Pp. 169–195.

Frey S., Hirsbrunner H-P., Jorns U. Time-Series Notation: A Coding Principle for the Unified Assessment of Speech and Movement in Communication Research. Tübingen: Gunter NarrVerlag, 1982.

Grushkin D. A. Writing Signed Languages: What For? What Form? // American Annals of the Deaf. 2017. Vol. 161 (5). Pp. 509–527. https://doi.org/10.1353/aad.2017.0001

Guest A. H. Dance Notation: The Process of Recording Movement on Paper. New York: Dance Horizons, 1984.

Guest A. H. Labanotation: The System of Analyzing and Recording Movement (4th ed.). New York: Routledge, 2005. https://doi.org/10.4324/9780203823866

Harrigan J. A. Proxemics, Kinesics, and Gaze // The New Handbook of Methods in Nonverbal Behavior Research. 2008. Pp. 136–198. https://doi.org/10.1093/acprof:oso/9780198529620.003.0004

Izquierdo C., Anguera M. T. Movement notation revisited: syntax of the common morphokinetic alphabet (CMA) system // Front. Psychol. 2018. Vol. 9:1416. https://doi.org/10.3389/fpsyg.2018.01416

Karg M., Samadani A.-A., Gorbet R., Kuhnlenz K., Hoey J., Kulic D. Body Movements for Affective Expression: A Survey of Automatic Recognition and Generation // IEEE Transactions on Affective Computing. 2013. Vol. 4. Issue 4. Pp. 341–359. https://doi.org/10.1109/t-affc.2013.29

Kendon A. Gesture // Annual Review of Anthropology. 1997. Vol. 26 (1). Pp. 109–128. https://doi.org/10.1146/annurev.anthro.26.1.109

Key M. R. Nonverbal communication: a research guide and bibliography. Metuchen, N.J.: The Scarecrow Press, 1977.

Kilpatrick C. E. Movement, Gesture, and Singing: A Review of Literature // Update: Applications of Research in Music Education. 2020. Vol. 38. Issue 3. Pp. 29–37. DOI: 10.1177/8755123320908612

Laban R. von, Lawrence F. C. Effort: Economy of Human Movement / 2nd ed. London: Macdonald & Evans, 1974.

Laumond J., Abe N. Dance Notations and Robot Motion. Cham (ZG): Springer International Publishing AG, 2016. https://doi.org/10.1007/978-3-319-25739-6

Liu H., Zhu Z., Iwamoto N., Peng Y., Li Zh., Zhou Y., Bozkurt E., Zheng, B. BEAT: A Large-Scale Semantic and Emotional Multi-modal Dataset for Conversational Gestures Synthesis // Computer Vision – ECCV 2022. 2022. Pp. 612–630. https://doi.org/10.48550/arXiv.2203.05297

Murillo E., Montero I., Casla M. On the multimodal path to language: The relationship between rhythmic movements and deictic gestures at the end of the first year // Frontiers in Psychology. 2021. Vol. 12. Pp. 1–8. https://doi.org/10.3389/fpsyg.2021.616812

Novack A. M., Wakefield E. M. Goldin-Meadow S. What makes a movement a gesture? // Cognition. 2016. Vol. 146. Pp. 339–348. https://doi.org/10.1016/j.cognition.2015.10.014

Qi X., Liu C., Li L., Hou J., Xin H., Yu, X. Emotion Gesture: Audio-Driven Diverse Emotional Co-Speech 3D Gesture Generation, IEEE Transactions on Multimedia. 2024. Pp. 1–11. https://doi.org/10.1109/TMM.2024.3407692

Streeck J. The Significance of Gesture: How it is Established // Papers in Pragmatics. 2010. Vol. 2. Issue 1-2. https://doi.org/2.10.1075/iprapip.2.1-2.03str

Shafir T., Tsachor R., Welch K. B. Emotion Regulation through Movement: Unique Sets of Movement Characteristics are Associated with and Enhance Basic Emotions // Frontiers in Psychology. 2016. Vol. 6. https://doi.org/10.3389/fpsyg.2015.02030

Stults-Kolehmainen M. A. Humans have a basic physical and psychological need to move the body: Physical activity as a primary drive // Frontiers in Psychology. 2023. Vol. 14. https://doi.org/10.3389/fpsyg.2023.1134049

Tonoli R. L., Costa P. D. P., Marques L. B. d. M. M., Ueda L. H. Gesture Area Coverage to Assess Gesture Expressiveness and Human-Likeness’ // International Conference on Multimodal Interaction (ICMI Companion ‘24), 4–8 November 2024, San Jose, Costa Rica. ACM, New York, NY, USA. https://doi.org/10.1145/3686215.3688822

Trujillo J. P., Vaitonyte J., Simanova I., Özyürek A. Toward the markerless and automatic analysis of kinematic features: A toolkit for gesture and movement research // Behavior Research Methods. 2018. Vol. 51 (2). Pp. 769–777. https://doi.org/10.3758/s13428-018-1086-8

Van Elk M., van Schie H. T., Bekkering H. Short-term action intentions overrule long-term semantic knowledge // Cognition. 2009. Vol. 111. Issue 1. Pp. 72–83. https://doi.org/10.1016/j.cognition.2008.12.002

Yang S., Wu Z., Li M., Zhang Z., Hao L., Bao W., Zhuang H. QPGesture: Quantization-Based and Phase-Guided Motion Matching for Natural Speech-Driven Gesture Generation // Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition (CVPR). 2023. Pp. 2321–2330. https://doi.org/10.48550/arXiv.2305.11094

Yoon Y., Cha B., Lee J.-H., Jang M., Lee J., Kim J., Lee G. Speech Gesture Generation from the Trimodal Context of Text, Audio, and Speaker Identity // ACM Transactions on Graphics. 2020. Vol. 39. Issue 6. https://doi.org/10.1145/3414685.3417838

Zhi Y., Cun X., Chen X., Shen X., Guo W., Huang S., Gao S. LivelySpeaker: Towards Semantic-Aware Co-Speech Gesture Generation // Proceedings of the IEEE/CVF International Conference on Computer Vision (ICCV). 2023. Pp. 20807–20817. https://doi.org/10.1109/ICCV51070.2023.01902